llms.txt. Com posicionar la teva marca a ChatGPT

Hi ha un gran debat entre els professionals i les millors agències SEO sobre el futur del SEO. Com farem SEO? i, sobretot, on es treballarà el SEO en el futur?, fins i tot hi ha qui com Neil Pattel passa a canviar de nom l'acrònim SEO -Search Engine Optimization- a Search Everywhere Optimization. I dins d'aquest “everywhere” ens trobem sobretot amb xarxes socials, Amazon i la IA -Intel·ligència Artificial- i, concretament, els LLMs o Large Language Models. En aquest article t'explicaré com connectar tècnicament la teva pàgina web amb els LLMs o Models de Llenguatge de Gran Escala perquè aquests et tinguin en consideració i apareguis en els seus resultats.

Que són els LLMs i d'on obtenen la informació

Abans d'aprofundir, és important entendre el context en el qual ens trobem. Els Models de Llenguatge de Gran Escala o Large Language Models (LLMs) són sistemes d'intel·ligència artificial dissenyats per comprendre, processar i generar llenguatge natural de manera coherent i contextualitzada. El seu funcionament és simple: s'entrenen amb enormes volums de dades per reconèixer patrons en el llenguatge i així poder respondre preguntes, redactar textos, programar, generar imatges i vídeos i moltíssimes coses més. Els LLMs més coneguts són Google Gemini, ChatGPT, Claude, DeepSeek o Grok, és a dir, sistemes d'IA que les persones usem assíduament i, que sens dubte, suposen ja una bona quota de les cerques o consultes que s'efectuen en Internet cada dia. I les empreses, òbviament, volem ser presents en aquestes cerques, però per a això hem de ser presents en les seves fonts d'informació.

La clau principal per a fer SEO a la IA és entendre d'on extreuen els LLMs la informació i així saber com podem incloure'ns. Els LLMs consulten pàgines web, blogs i xarxes socials, enciclopèdies com Wikipedia i bases de dades organitzades. Tot això ho complementen analitzant milions de textos i converses i fins i tot les converses dels usuaris amb els LLMs. Així que la nostra eina principal per a aparèixer a ChatGPT, Gemini o Grok és la nostra pàgina web.

El contingut és el rei

El contingut és el rei (King is content) va ser encunyada per primera vegada per Bill Gates en un assaig de 1996. Aquesta frase és, sens dubte, la frase més popular entre els SEO de tot el món i continuarà sent vigent per molts anys. Abans de treballar tècnicament perquè el nostre contingut sigui accessible pels LLMs com ChatGPT o Google Gemini, hem de plantejar-nos si el contingut que generem és rellevant i és d'interès. Això és condició sine qua non ja que si el nostre contingut no és d'interès, original, fresc i rellevant, per molt que permetem l'accés als diferents LLMs, aquests no ens tindran en consideració. Així que el primer és crear contingut rellevant, ben estructurat, redactat correctament i de manera senzilla per a facilitar la seva lectura. A més, ajuda molt, que incloguem referències i enllaços a fonts que gaudeixin de reputació i el nom de l'autor. En resum, aplicar els criteris clàssics del E-E-A-T a nivell de SEO.

Com permetre que ChatGPT accedeixi a la nostra web

Una vegada tenim el contingut d'interès a la nostra pàgina web, el següent pas és permetre l'accés a la IA a la nostra pàgina web. Si li preguntes a qualsevol consultor SEO com és el fitxer .txt més important per al SEO, et respondrà que el robots.txt. Aquest és un fitxer que indica als cercadors com Google i altres rastrejadors o crawlers al fet que seccions de la teva pàgina web poden accedir i a quins no. És un fitxer de summa importància i, el principal fitxer, encarregat d'arruïnar el SEO de moltes pàgines en migracions SEO. El primer que hem de fer per permetre que els LLMs accedeixin a la nostra pàgina web és no bloquejar-los l'accés mitjançant robots.txt.

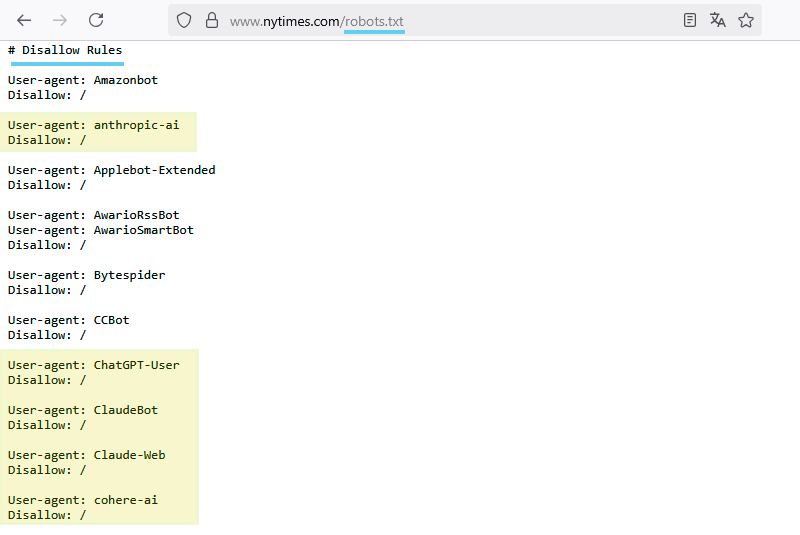

Aquest bloqueig dels crawlers o rastrejadors d'IA pot ser conscient o inconscient. Si accedim per exemple al fitxer robots.txt del New York Times, veurem que entre les seves 268 línies de codi, hi ha un bloc creat expressament per bloquejar l'accés de crawlers o bots com ChatGPT o Claude; és a dir New York Times impedeix conscientment que ChatGPT o Claude puguin accedir a la pàgina web d'aquest diari digital i usar-la com a font de coneixement.

Si volem confirmar que aquest fitxer funciona, podem preguntar-li explícitament a ChatGPT si pot accedir a la pàgina de The New York Times. Xat GPT ens confirma que no pot accedir i, a més, explicita que no pot accedir a causa del fitxer robots.txt

Així que, una vegada hàgim publicat contingut d'interès a la nostra pàgina web, hem de permetre que els LLMs puguin accedir al mateix a través de la nostra pàgina web mitjançant la correcta configuració del fitxer robots.txt. Ara que tenim el contingut i permetem a ChatGPT o Gemini accedir a la nostra pàgina web, el següent pas és com potenciar i facilitar-los que accedeixin al contingut de la nostra pàgina web que ens interessa, i aquí entra en joc el fitxer llms.txt.

Llms.txt facilita l'accés als continguts de la nostra pàgina web

El llms.txt és un fitxer la funció del qual és crear una espècie de pont entre una pàgina web i els diferents sistemes d'IA, per a facilitar-los entendre el context i la rellevància del contingut de la nostra pàgina web.

Quan els sistemes d'IA intenten llegir la nostra pàgina web, es troba amb menús, JavaScript, CSS i altres elements de codi que els dificulta accedir al contingut que realment ens interessa que accedeixin. El fitxer llms.txt elimina aquestes barreres filtrant a la IA la informació rellevant en un format que la IA pot entendre fàcilment. Mitjançant aquest fitxer oferim una descripció estructurada i concisa del contingut del lloc web que volem que aparegui a la IA, orientada de manera específica a models de llenguatge d'IA que facilita la seva comprensió i, per extensió, la precisió de les seves respostes i el possible engagement dels nostres futurs usuaris. Gràcies a aquest fitxer prioritzem quin contingut volem que les IA captin de la nostra pàgina web, parlin de la nostra marca i ens incorporin com a font de referència.

L'ús que li hem de donar a l'arxiu llms.txt dependrà de la tipologia de la nostra pàgina web. Si és una botiga en línia tendirem a destacar categories i descripcions de productes, en pàgines corporatives destacarem serveis i en blogs sobretot categories de notícies i autors.

Com crear el fitxer llms.txt

El fitxer llms.txt és un fitxer ideat per Jeremy Howard, cofundador d'Answer.ai. És un fitxer creat en markdown i que segueix una estructura concreta. Si no estàs familiaritzat amb markdown, no et preocupis, el markdown és molt fàcil d'usar, és una forma senzilla d'escriure text i donar-li format sense usar codi complex. Per exemple, utilitza # per a l'H1, ## per a H2 i *text en negreta*. Aquí tens una guia de markdown.

El fitxer llms.txt s'estructura en quatre elements principals:

- El títol. L'arxiu ha de començar amb un encapçalat H1 (#) amb el títol del projecte o de la pàgina web.

- El resum. Aquesta secció és primordial i serveix per a explicar clarament el propòsit, context i contingut del lloc. Ha de ser una cita en bloc (>)

- Seccions principals. Les seccions posteriors han d'usar encapçalats H2 (##) per a organitzar els enllaços de la documentació.

- Continguts opcionals. Finalment la secció “Opcional" pot contenir enllaços a contingut addicional que pot ser útil però no essencial.

Un exemple seria:

Mentre el fitxer llms.txt facilita la navegació i estructura, pots complementar-ho amb el fitxer llms-full.txt, que actua com un document molt més detallat de suport i directrius específiques per als LLMs. Per a pàgines web mitjanes o corporatives, podem prescindir directament del llms-full.txt

De manera similar a com creguem un fitxer robots.txt, podem crear l'arxiu llms.txt usant un bloc de notes, el guardem amb el nom exacte de llms.txt i ho pugem a l'arrel del domini via ftp perquè els sistemes d'IA el trobin sense dificultat.

Si prefereixes generar l'arxiu llms.txt de manera automàtica pots recórrer a eines online com Wordlift o Firecrawl, hi ha fins i tot plugins de WordPress per generar arxius llms.txt

Per a evitar els errors més habituals, és recomanable que una vegada tinguem el fitxer correctament creat i pujat al nostre servidor comprovem que:

- És accessible des de la nostra web, p. ex. https://latevaweb.com/llms.txt

- Està correctament codificat en markdown

- No usem més d'un H1 i no ens excedim amb l'ús d'H2 i H3

- Inclou exclusivament la informació que desitgem comunicar i que no incloguem enllaços irrellevants.

- El bloc de resum estigui ben redactat

- L'arxiu està actualitzat

- El nostre Google Analytics registri l'accés dels bots a la nostra pàgina web en la secció de “adquisició de trànsit”.

La implementació de l'arxiu llms.txt ens ajudarà al fet que els diferents LLMs com ChatGPT o Gemini, entre altres, accedeixin a la nostra pàgina web i la utilitzin com a font de coneixement i mostrin la nostra marca o empresa en els seus resultats. La presència de la nostra marca en les respostes de LLMs ens ajudarà al fet que la nostra marca sigui reconeguda pels nostres potencials clients i ens generarà negoci i reputació. Com SEOs el nostre àmbit d'acció s'ampliarà i treballarem per a aconseguir que la nostra marca sigui present en qualsevol plataforma, sigui una IA o un cercador com Google, on es realitzi una consulta.

Conclusió

El SEO està evolucionant cap al que es denomina "Search Everywhere Optimization", ja no hem de treballar la presència de la nostramarca únicament a cercadors com Google sinó que hem de ser presents en els sistemes d'IA quan algú efectuï una consulta. Per a això hem de generar contingut rellevant, ben estructurat i accessible pels sistemes d'IA. La configuració adequada d'arxius com robots.txt i llms.txt és essencial perquè els LLMs puguin rastrejar i comprendre correctament el contingut de la nostra pàgina web i augmentar la visibilitat de la nostra marca en el context de la intel·ligència artificial.

Notícies relacionades

Tens un projecte en ment? En volem saber més!

El fitxer llms.txt és el pont entre la IA i la teva pàgina web