¿Está mi web bloqueando la IA?

En la era digital actual, donde la inteligencia artificial (IA) juega un papel fundamental en la búsqueda de información y el análisis de contenido, es crucial asegurarse de que tu web esté accesible para los bots de los modelos de lenguaje (LLMs). Estos bots, como los de OpenAI, Google, y otros, se encargan de rastrear y analizar páginas web para ofrecer resultados relevantes en los motores de búsqueda.

De forma similar a como operan los bots en el proceso de SEO, estos primero encuentran un contenido, lo rastrean, escanean, clasifican y almacenan en su memoria. En el caso de que les resulte de calidad, este será elegible para aparecer en sus respuestas.

A partir de aquí, lo que nos debemos plantear es si nos interesa que nuestra empresa, sus productos o servicios aparezcan en los resultados de IA. Si tu respuesta es sí, sigue leyendo. De lo contrario, puedes dejarlo aquí o aprovechar este contenido para hacer lo contrario.

Pero vamos a suponer que nos interesa que la IA rastree nuestros contenidos. Y la pregunta que te estarás haciendo es: ¿está mi web bloqueando el acceso a estas herramientas? Pues es posible que sí, aunque no lo sepas y no lo quieras.

¿Cómo comprobar si la IA puede acceder a mi web?

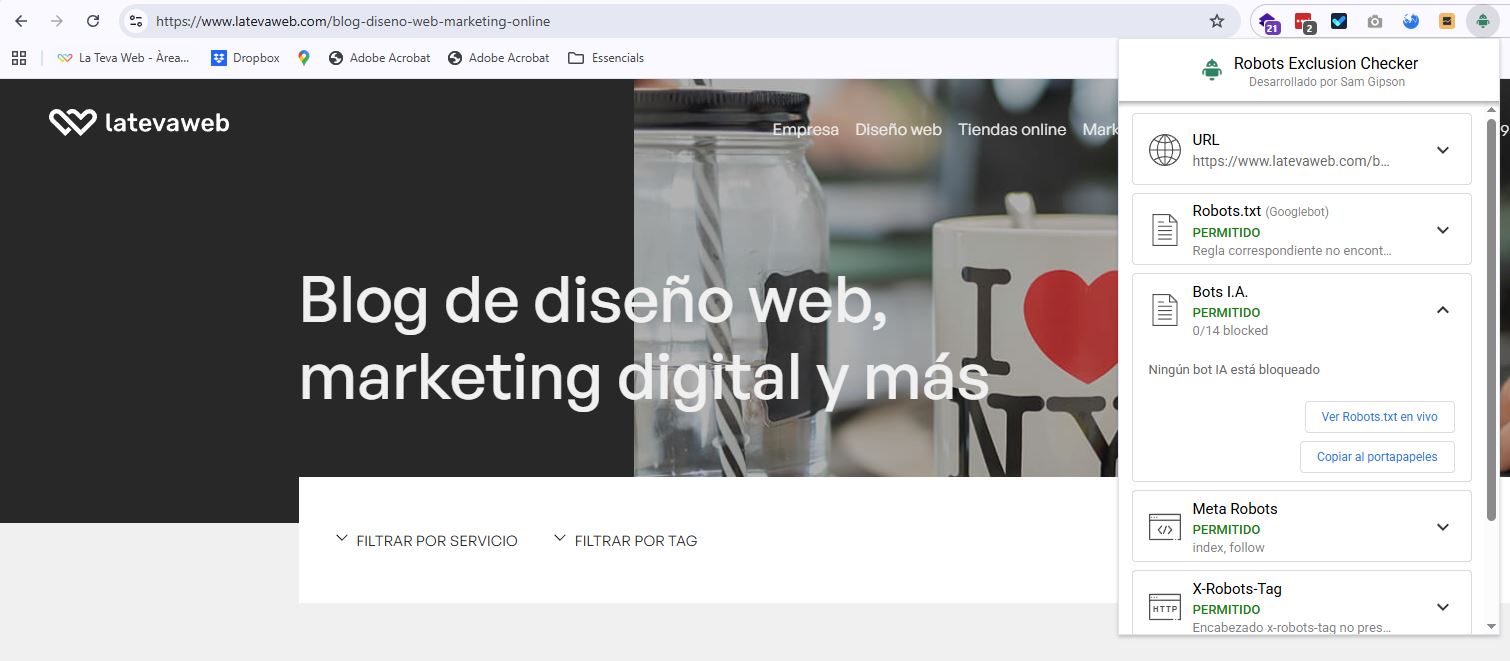

Usando la extensión Robots Exclusion Checker

Esta extensión es una maravilla para detectar URLs que no pueden ser indexadas por motivos variados. Pero en este caso, además, va a comprobar si estamos bloqueando los 14 bots de IA más habituales mediante robots.

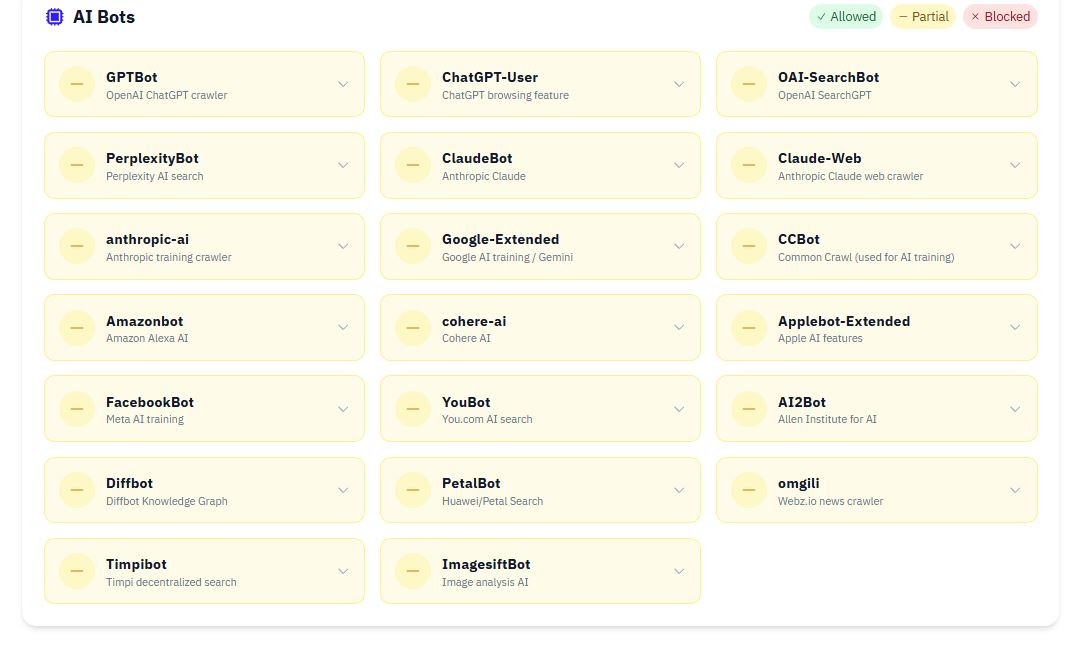

Con LLMPulse

Esta herramienta de GEO, que hemos mencionado en alguna otra ocasión, viene con una pequeña herramienta llamada "Robots.txt checker", que nos va a dar luz. Esta es mucho más completa, pues analiza 20 bots y nos da detalles sobre si el bloqueo es total o parcial, y dónde localizarlo. Este ejemplo es de un cliente real, y es un drama (de fácil solución).

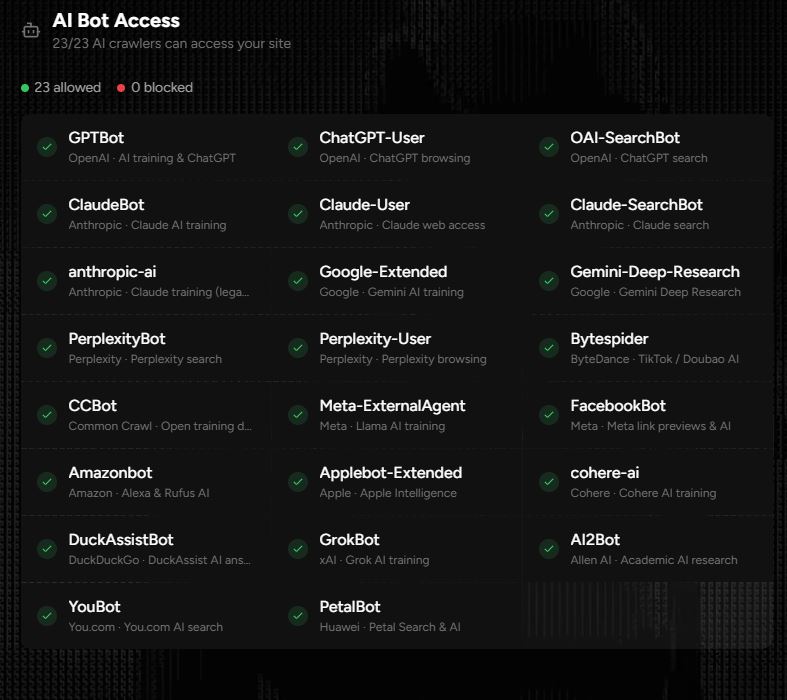

Con AEO Checker

Esta es una herramienta libre de GEO que está bastante bien. Nos da mucha información adicional además de la que vemos aquí, pero esta te la da de forma exhaustiva. Mide 23 bots y da todo lujo de detalles.

4. Métodos adicionales

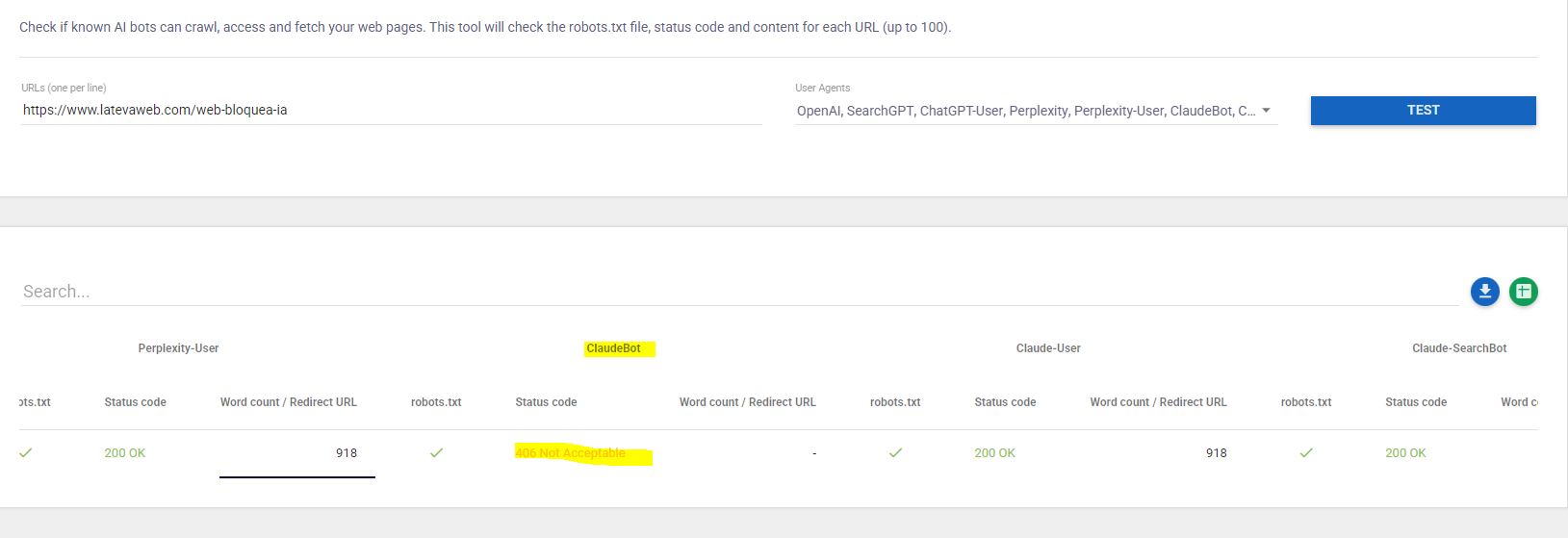

Hemos mencionado estos 3 porque son sencillos, accesibles y muy intuitivos. Ahora bien: si la mayoría de bloqueos a la IA provienen de configuraciones de robots.txt, no siempre es así. En ocasiones, el bloqueo puede venir por un ente superior, normalmente un servidor con muchas capas de seguridad o con prevención contra ataques, o un CDN receloso de determinadas consultas (especialmente Cloudflare).

En estos casos te recomendamos usar el AI Bots Testing Tools de Techincal SEO. En este caso no sólo va a comprobar si el robots.txt nos bloquea. Va a emular ser un agente de IA, y va a ver la respuesta de nuestro servidor y el acceso al contenido. Puede dar algún falso positivo, pero todavía no hemos visto un falso negativo. Paradógicamente, haciendo este post hemos detectado que Claude no podía acceder a él:

Adicionalmente, puedes hacer lo siguiente:

- Revisar la configuración de tu CDN

- Consultar con tu servicio de hosting si están aplicando alguna regla restrictiva que pueda afectar

- Realizar comprobaciones empíricas: pídele a tu asistente que acceda a una URL de tu sitio web y la procese. Si te dice que no puede, mal vamos

- Emular ser un bot de IA, mediante navegador o herramientas como Screaming Frog, para probar acceder al contenido

- Si tienes tiempo, conocimientos y permisos de acceso, puedes acceder a los logs del servidor, cruzar por los bots de IA que te interesen, y sabrás: cuáles te visitan con qué frecuencia y si estamos bloqueando el acceso a algunos de ellos

El acceso es necesario pero no suficiente

Como comentábamos al inicio, el camino hacia el GEO empieza porque los bots de IA como ChatGPT puedan acceder a tu sitio web. Este paso es imprescindible, pero necesitarás mucho más para alcanzar la deseada citación o mención.

Pero el acceso a los bots de IA es solo el primer paso. Una vez que hayas permitido este acceso, es esencial trabajar en la optimización de tu contenido, la estructura del sitio y otros aspectos técnicos para mejorar la clasificación en los resultados de IA. Básicamente el motor del GEO es hacer SEO, pero SEO del bueno y con un enfoque orientado a los LLMS.

Si ya has abierto la puerta a la IA, has dado un primer paso importantísimo. Abordaremos en otros posts lo que viene después ;)

Noticias relacionadas

¿Tienes un proyecto en mente? Cuéntanoslo

El camino hacia el GEO empieza porque los bots de IA como ChatGPT puedan acceder a tu sitio web